本站收集了一篇Python库相关的编程文章,网友怀飞尘根据主题投稿了本篇教程内容,涉及到数据科学、Python库、3个用于数据科学的顶级Python库相关内容,已被468网友关注,相关难点技巧可以阅读下方的电子资料。

3个用于数据科学的顶级Python库

Python有许多吸引力,如效率,代码可读性和速度,使其成为数据科学爱好者的首选编程语言。Python通常是希望升级其应用程序功能的数据科学家和机器学习专家的首选。

由于其广泛的用途,Python拥有大量的库,使数据科学家可以更轻松地完成复杂的任务,而无需很多编写代码的麻烦。以下是数据科学的前3个Python库。

使用这些库将Python转化为一个科学的数据分析和建模工具。

1.NumPy

NumPy(Numerical Python的缩写)是配备有用资源的顶级库之一,可帮助数据科学家将Python转变为强大的科学分析和建模工具。流行的开源库可以在BSD许可下使用。它是用于在科学计算中执行任务的基础Python库。NumPy是一个更大的基于Python的开源工具生态系统的一部分,称为SciPy。

他的库为Python提供了大量的数据结构,可以毫不费力地执行多维数组和矩阵计算。除了用于求解线性代数方程和其他数学计算外,NumPy还可用作不同类型通用数据的通用多维容器。

此外,它与其他编程语言(如C / C ++和Fortran)完美集成。NumPy库的多功能性使其能够轻松快速地与各种数据库和工具结合使用。

2.Pandas

Pandas是另一个很棒的库,可以增强你的数据科学Python技能。与NumPy一样,它属于SciPy开源软件系列,可在BSD免费软件许可下使用。

Pandas提供多功能和强大的工具,用于整理数据结构和执行大量数据分析。该库适用于不完整,非结构化和无序的实际数据,并附带用于整形,聚合,分析和可视化数据集的工具。

此库中有三种类型的数据结构:

- Series:单维,均匀阵列

- DataFrame:具有异构类型列的二维

- Panel:三维,大小可变阵列

例如,让我们看看Panda Python库(缩写为pd)可用于执行一些描述性统计计算。

让我们从导入库开始。

import pandas pd

让我们创建一个系列词典。

d 'Name':pd.Series'Alfrick''Michael''Wendy''Paul''Dusan''George''Andreas' 'Irene''Sagar''Simon''James''Rose' 'Years of Experience':pd.Series 'Programming Language':pd.Series'Python''JavaScript''PHP''C++''Java''Scala''React''Ruby''Angular''PHP''Python''JavaScript'

让我们创建一个DataFrame。

df pd.DataFramed

下面是一个很好的输出表:

Name Programming Language Years of Experience Alfrick Python Michael JavaScript Wendy PHP Paul C++ Dusan Java George Scala Andreas React Irene Ruby Sagar Angular Simon PHP James Python Rose JavaScript

下面是这个示例的全部代码:

import pandas pd #creating a dictionary of series d 'Name':pd.Series'Alfrick''Michael''Wendy''Paul''Dusan''George''Andreas' 'Irene''Sagar''Simon''James''Rose' 'Years of Experience':pd.Series 'Programming Language':pd.Series'Python''JavaScript''PHP''C++''Java''Scala''React''Ruby''Angular''PHP''Python''JavaScript' #Create a DataFrame df pd.DataFramed printdf

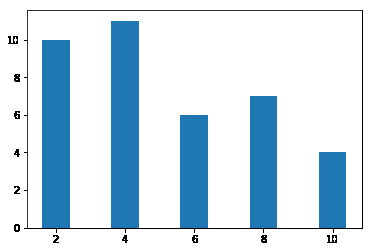

3.Matplotlib

Matplotlib也是SciPy核心软件包的一部分,并在BSD许可下提供。它是一个流行的Python科学库,用于生成简单而强大的可视化。你可以使用Python框架进行数据科学生成创意图形,图表,直方图以及其他形状和图形,而无需担心编写多行代码。

例如,让我们看看如何使用Matplotlib库创建一个简单的条形图。

让我们从导入库开始。

matplotlib import pyplot plt

让我们为x轴和y轴生成值。

让我们调用绘制条形图的函数。

plt.xy

让我们展示一下情节。

plt.

这是条形图:

下面是这个示例的全部代码:

#importing Matplotlib Python library matplotlib import pyplot plt #same as import matplotlib.pyplot as plt #generating values for x-axis x #generating vaues for y-axis y #calling function for plotting the bar chart plt.xy #showing the plot plt.

Python编程语言在数据处理和准备方面做得很好,但对于复杂的科学数据分析和建模却不那么重要。用于数据科学的顶级Python框架有助于填补这一空白,允许你执行复杂的数学计算并创建能够理解数据的复杂模型。

总结

以上就是这篇文章的全部内容了,希望本文的内容对大家的学习或者工作具有一定的参考学习价值,谢谢大家对码农之家的支持。如果你想了解更多相关内容请查看下面相关链接